Redes Neuronais. Afinal, como é que as máquinas aprendem?

por Marta Amaral | 24 de Abril, 2025

As redes neuronais são também designadas por redes neuronais artificiais (ANNs) ou redes neuronais simuladas (SNNs). Fazem parte da aprendizagem automática e estão no centro dos principais modelos de inteligência artificial.

O termo parece complicado (e é mais ou menos), mas se olharmos para o corpo humano tudo fica mais simples.

Pensemos no cérebro, que é composto por várias células. Estas células são neurónios que comunicam entre si e que nos ajudam a perceber o mundo, a tomar decisões ou a aprender coisas novas.

As redes neuronais artificiais têm precisamente a mesma função, mas no computador. Ou seja, tentam imitar o comportamento do cérebro na máquina.

Em vez de células verdadeiras, estas redes usam pequenos programas (chamados “nós” ou “neurónios artificiais”) que recebem informação, fazem contas simples e passam o resultado a outros “nós”.

Estes programas estão organizados em camadas: uma onde entra a informação, outras que fazem os cálculos e uma final onde sai a resposta.

De uma forma prática e com exemplos. O que fazem as redes neuronais?

- Constroem algoritmos de pesquisa, a rede está atenta aos interesses e personaliza a pesquisa em função dos gostos de cada utilizador.

- Se mostrarmos uma fotografia de um gato a uma rede neuronal ela pode aprender a dizer que é um gato – porque já viu muitas imagens de gatos e cães e aprendeu a distingui-los.

- Pode ouvir uma gravação e reconhecer que está a ser dito um “Olá”.

Como tudo começou

Parece recente mas a ideia de imitar o cérebro humano com máquinas surgiu ainda no início do século XX e começou a concretizar-se entre 1940 e 1950.

Warren McCulloch (um neurofisiologista) e Walter Pitts (um matemático) criaram, em 1943, um modelo matemático simples que propunha que o cérebro podia ser representado como um sistema de neurónios que comunicam através de sinais elétricos, como se fossem “interruptores” que ligam e desligam.

A semente estava plantada e em 1958, o cientista Frank Rosenblatt inventou a primeira rede neuronal prática que conseguiu, por exemplo, identificar se uma imagem tinha uma forma ou uma cor específica.

Apesar dos primeiros avanços, as redes neuronais passaram por uma fase difícil na década de 1970 onde foram desacreditadas. Os cientistas convenceram-se que as redes neuronais não iam ser eficazes para resolver problemas complexos.

A falta de capacidade de processamento e a limitação dos modelos fizeram com que o interesse diminuísse. Este período ficou conhecido como o “inverno das redes neuronais”.

A redescoberta

Nos anos 1980, as redes neuronais começaram a ser redescobertas graças a dois avanços importantes:

- O algoritmo de retropropagação (backpropagation), desenvolvido por Geoffrey Hinton e outros cientistas – permitiu ajustar os pesos das redes de maneira mais eficiente e com isto as redes neuronais começaram aprender de forma mais eficaz, mesmo com dados mais complexos.

- O aumento na capacidade de processamento computacional, que permitiu que as redes neuronais fossem utilizadas para problemas mais avançados.

A Explosão do Deep Learning – 2000s até hoje

As redes neuronais artificiais estão por trás de grande parte da tecnologia de IA que usamos atualmente.

São a base para a inteligência artificial. É através destas redes que é possível pôr a máquina a pensar – é o que leva a inteligência natural até às máquinas.

Hoje em dia, as redes neuronais e o deep learning são fundamentais para muitas tecnologias avançadas, desde assistentes virtuais como a Siri e o Google Assistant, até carros autónomos, e diagnósticos médicos. A inteligência artificial baseada em redes neuronais está a transformar a maneira como interagimos com a tecnologia.

As redes neuronais aprendem com dados de treino, que as ajudam a melhorar a sua precisão ao longo do tempo. Com o tempo e com muitos exemplos, a rede vai aprendendo a melhorar as suas respostas, um pouco como nós aprendemos com a prática.

O que pensam os “professores da máquina” sobre os avanços da IA nos dias de hoje?

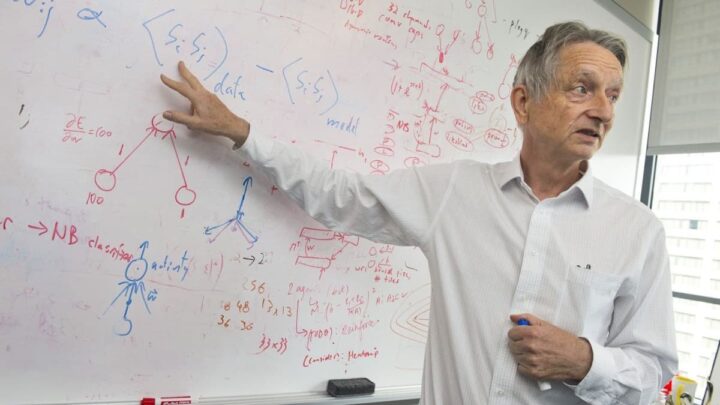

Quando falamos de redes neuronais existem nomes que merecem ser falados. Geoffrey Hinton é sem dúvida um deles.

O cientista de computação britânico-canadense fez várias contribuições importantes para a área.

No ano passado, Hinton recebeu o Prémio Nobel da Física de 2024 ao lado do norte-americano John Hopfield pelas descobertas com as redes neuronais artificiais que fazem com que a máquina consiga aprender.

Em concreto, John Hopfield, de 91 anos, “inventou uma rede que utiliza um método para armazenar e recriar padrões”, explica a Academia Sueca das Ciências, e acrescenta: “Esta rede, conhecida como rede de Hopfield, trabalha passo a passo para encontrar a imagem armazenada que mais se assemelha à imagem imperfeita com que foi alimentada”.

Já Geoffrey E. Hinton, de 77 anos, baseou-se nos estudos de Hopfield para criar, em 1985, a Máquina de Boltzmann, “um método que pode descobrir independentemente as propriedades dos dados e que se tornou importante para as grandes redes neuronais artificiais utilizadas atualmente”.

Hoje em dia as redes neurais estão em todo o lado, são o motor de funcionamento de sistemas de IA generativa que usamos todos os dias, como o ChatGPT.

Era de esperar que Hinton ficasse entusiasmado com o rápido progresso da inteligência artificial. No entanto, em 2023, o “pai da Inteligência Artificial” partilhou uma mensagem de preocupação.

Quando saiu da Google Deepmind (subsidiária da empresa para IA) passados 10 anos, confessou que estava assustado com a velocidade do desenvolvimento e acabou por se juntar às vozes que pedem uma regulamentação mais proativa da tecnologia — uma opinião relevante, uma vez que vem de quem conhece tão bem as bases da máquina.